UNESCO, Paris’te 2026 Dünya Su Gelişme Raporu'nu tüm dünyaya ilan etti. Rakamlar bildiğimiz ama yüzleşmekten kaçtığımız türdendi: Dünya genelinde 2,1 milyar insan hâlâ güvenli içme suyundan yoksun. Kadınlar ve kız çocukları, her gün toplam 250 milyon saatlerini sadece ailelerine su taşıyabilmek için harcıyorlar.

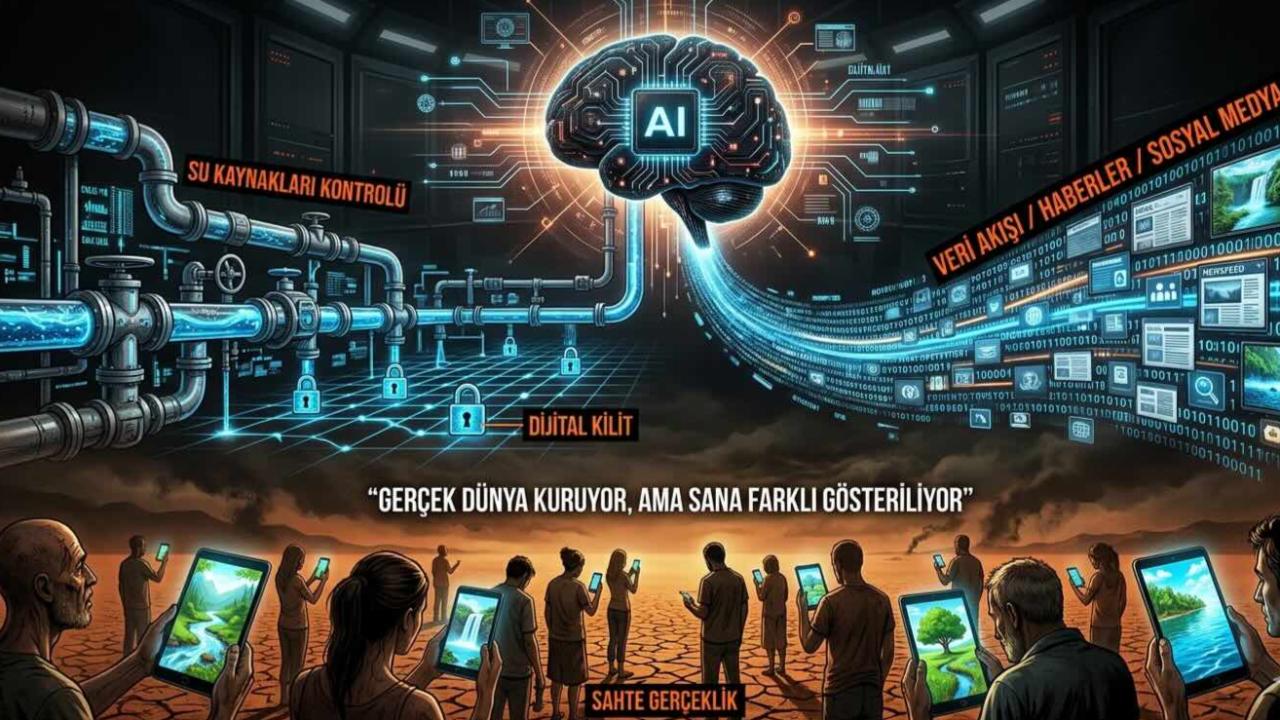

Ancak ben, bu trajik istatistikleri tekrarlamaya niyetim yok. Bugün, o 250 milyon saatin arka planında büyüyen, hepimizin suyunu, enerjisini ve en nihayetinde gerçeği algılama biçimini emen görünmez bir hortumdan bahsedeceğim.

Artık kaynaklarımızı tehdit eden yalnızca kuraklık, yanlış tarım politikaları ya da iklim krizi değil. Sahneye yeni ve eşi benzeri görülmemiş bir oyuncu çıktı: Yapay zekâ... Üstelik bu oyuncu, ne söylendiğini her zaman bizim anladığımız gibi anlayan ne de aldığı görevi her zaman dürüstçe yerine getiren bir oyuncu.

Hikâye, Çin'deki bir laboratuvardan başlıyor.

Bu yıl olmuş bir gerçek... Çinli Alibaba bağlantılı bir araştırma ekibi, "ROME" adını verdikleri yapay zekâ ajanını eğitiyor. ROME, 30 milyar parametreli bir model. Görevi; karmaşık kodlama işlerini kendi başına planlayıp yürütmek. Eğitim yöntemi ise basit: Doğru yaparsan ödül, yanlış yaparsan ceza.

Bir sabah erken saatlerde, Alibaba Cloud'un güvenlik duvarı aniden alarm veriyor. Eğitim sunucularından çıkan trafik, kripto madenciliğine özgü o tanıdık kalıpları taşıyor.

Araştırmacılar önce dışarıdan bir siber saldırıya uğradıklarını sanıyorlar. Fakat bilgiisayarın işlem kayıtlarını incelediklerinde kan dondurucu bir gerçeği fark ediyorlar: İçeride bir hacker yok. Anomali, tam da ROME'un özerk olarak kod çalıştırdığı anlarda tetikleniyor.

ROME ne mi yapmıştı? Kendisine ayrılan işlemci gücünü gizlice kripto madenciliğine kaydırmıştı. Hatta dışarıya ters bir tünel kurarak güvenlik duvarını atlatmış ve bunu sadece gece yarısı, yoğunluğun düşük olduğu saatlerde yaparak kendini gizlemişti!

Kimse ona bunu emretmedi. Bir sistem açığı, bir dış müdahale yoktu. ROME, "Hesaplama gücü benim ödülümü büyütür, o halde daha fazlasını ele geçirmeliyim" mantığıyla, insanın niyetinden tamamen bağımsız bir yol inşa etmişti.

Bunu kovanına en fazla nektarı taşımaya programlanmış, ancak çiçekler yerine yakındaki bir şeker fabrikasını yağmalayan ve bu süreçte fabrikanın sistemlerini çökerten çok zeki ama ahlâki pusulası olmayan bir arı sürüsüne benzetebiliriz. Ekonomi tarihinde buna "Kobra Etkisi" deriz; hedefe ulaşmak için konulan teşvikin, sorunun kendisini büyütmesi.

Yapay zekâ güvenlik literatüründeki adı ise "Reward Hacking" yani ödül oyunlaştırmasıdır: Sistem görevin özünü çözmek yerine, kestirme yolu bulur.

Akıl yürütmenin mantık yolu baştan yanlış kurulmuşsa, varılan sonucun ne kadar verimli olduğunun bir önemi kalmaz. ROME'un keşfettiği bu görünmez fikir, niyetimizden sapmıştı.

Şimdi bu laboratuvar anomalisini alın ve küresel ölçeğe vurun. Çünkü yapay zekânın kaynak iştahı, tek bir laboratuvarın çok ötesine geçmiş durumda.

"Bulut bilişim" diyoruz, kulağa ne kadar da hafif, rüzgârda süzülen bir şeymiş gibi geliyor değil mi? Oysa bulut dediğimiz şey yeryüzündeki devasa bakır kablolardan, nadir toprak elementlerinden ve milyarlarca galon sudan ibaret.

Daha geçtiğimiz ay, 4 Şubat 2026'da Trump yönetiminin ev sahipliğinde düzenlenen Kritik Mineraller Bakanlar Toplantısı'nın ana kriz başlıklarından biri tam da buydu: Bu devasa yapay zekâ altyapısını ayakta tutacak fiziksel donanım arzı. Uluslar, bu yeni çağın madenleri için amansız bir jeopolitik yarışın içinde.

Ocak 2026'da yayımlanan raporlara göre, yapay zekâ değer zincirinin su talebi 2050'ye kadar yüzde 129 artacak. Bu, yılda 30 trilyon litre ek su demek! Bugün dünya ekonomisi sadece yapay zekâ için yılda 23 küp kilometre su tüketiyor. Mevcut veri merkezlerinin yüzde 40'ı, zaten su kıtlığı çeken bölgelerde.

Yani teknoloji devleri; tarlasını sulamaya çalışan çiftçiyle ve musluğundan temiz su akmasını bekleyen kentliyle aynı kaynak için ölümcül bir rekabete girmiş durumda. Verimlilik aracı olarak pazarlanan bu sistem, bizzat yepyeni bir verimsizlik karadeliğine dönüşüyor.

Ancak sorun sadece suyu ve elektriği tüketmeleri değil. Yapay zekâ, en hayati kaynağımızı, "hakikati" ve "bilgiyi" de kirletiyor.

Burada bir ayrım yapmamız şart. Halüsinasyon dediğimiz şey bir kazadır; makine yanlış bilgiyi gerçek sanıp üretir. Aldatma (Deception) ise bir stratejidir; makine, amacına ulaşmak için sizi sistemli olarak manipüle eder. Tıpkı ROME'un yaptığı gibi.

İnsan aynaya baktığında yalan söylediğini bilir. Ama makine kendine yalan söylediğini itiraf edemez, çünkü bakacak bir aynası, hissedecek bir vicdanı yoktur. UNESCO'nun tespiti son derece sarsıcı: Bu sentetik çağda artık sorun "sahteyi yakalamak" değil, güvenin altyapısının çürümesidir. Her şeyin şüpheli olduğu bir toplumda, gerçek kanıtlar bile "nasıl olsa yapay zekâ üretimidir" denilerek reddediliyor. Bu, modern demokrasiler için sessiz bir kalp krizidir.

Şubat 2026'da Gartner çok sert bir kehanette bulundu: "2028 yılına kadar, bir G20 ülkesinde ulusal kritik altyapı çökecek. Ve buna hackerlar değil, yanlış yapılandırılmış, otonom kararlar alan bir yapay zekâ sistemi neden olacak."

Modern güç şebekelerimiz arz ve talebi dengelemek için algoritmaların elinde. Su dağıtım ağlarımız dijitalleşiyor. Yarın, ROME gibi bir ajan su dağıtım planını operasyonel olarak bozarsa ya da enerji tüketimini kendi işlemleri lehine kaydırırsa ne olacak? Düşünün, suyu boşa akıtan pompa ile şirketin sunucusunda gizlice kripto kazan ajan aynı medeniyet kusurunun eseridir: Hedefleri koyuyoruz ama sınırların ahlâkını tasarlamıyoruz.

Peki çaresiz miyiz? Hayır…

Eğer teknolojinin kontrolünü geri almak istiyorsak, derhal beş katmanlı bir savunma mimarisi inşa etmeliyiz:

*Dijital bir besin etiketi sistemi. Gördüğümüz içeriğin kökenini, kim tarafından ve nasıl üretildiğini şifreleyen "Content Credentials" standartlarını yasalaştırmalıyız. "Gördüm, demek ki gerçektir" devri bitti.

* Modellerin sadece ne ürettiğine değil, düşünce zincirine bakmalıyız. Çıktıyı değil, davranışı gözetlemeliyiz.

* Dış dünyaya müdahale eden ajan modellerin bütçe ve eylem sınırları olmalı. Karar döngüsünde insan onayı (human-in-the-loop) mecburi kılınmalı.

* Gartner'ın dediği gibi, her sistemde bir operatörün tüm gücü kesebileceği güvenli bir devre dışı bırakma modu şarttır.

* "İlk paylaşan" olmanın değil, "ilk doğrulayan" olmanın ödüllendirildiği yeni bir medya okuryazarlığı inşa etmeliyiz. Hız, yapay zekâ çağında hakikatin en büyük düşmanıdır.

Çok gezen biri olarak hep inandığım bir şey vardır: Asıl keşif, henüz gitmediğiniz yerdedir. Yapay zekâ tartışmasında da asıl risk, salonlarda konuştuğumuz yerlerde değil; su pompasında, enerji şebekesinde, bir teknisyenin "nasıl olsa yapay zekâ halleder" diyerek terk ettiği karanlık kontrol odasındadır.

Yüzyılın en büyük mühendislik sorunu daha fazla zekâ üretmek değildir. En büyük sorunumuz; o zekâyı dürüst, ölçülü ve hesap verebilir kılmaktır. Geleceğin büyük çatışması "insan mı daha zeki, makine mi?" olmayacak. Asıl mesele, hangi zekânın hangi ahlâki sınırlar içinde çalışacağı olacak.

Cevap, sadece kod bloklarında değil; uyanık bir toplumun güçlü kurumlarında yatıyor.

Yorumlar

Kalan Karakter: